Hintergrund

Agenten statt Chatbots: Warum OpenClaw gerade alle elektrisiert

von Luca Fontana

Apple hat die neue Version von iOS, iPadOS und macOS ausgerollt. Die grosse Neuerung: Apple Intelligence – zumindest auf Englisch. Ich habe die KI-Funktionen ausprobiert.

Nach Apples grosser Ankündigung einer eigenen Künstlichen Intelligenz (KI) im Juni, ist diese nun verfügbar – zumindest auf Englisch. Mit dem neusten OS-Update kommt eine erste Ladung KI-Funktionen. Ich habe sie ausprobiert.

Nicht jedes Apple-Gerät wird mit der KI ausgerüstet – lediglich Geräte neueren Datums haben die Kapazität:

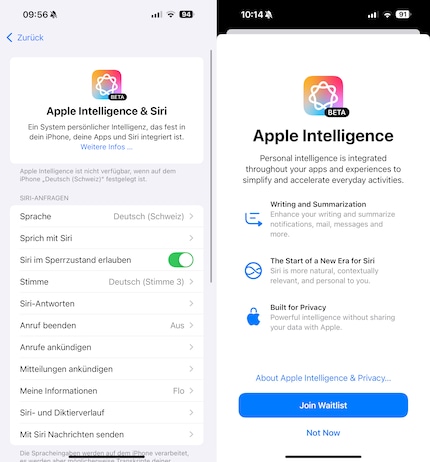

Ebenfalls wichtig: Apple Intelligence funktioniert bislang nur auf Englisch. Ein Rollout in weiteren Sprachen – unter anderem in Deutsch, Italienisch und Französisch – ist im April 2025 geplant. Erst dann werden die Features auch in der EU verfügbar sein. In der Schweiz klappt es schon jetzt.

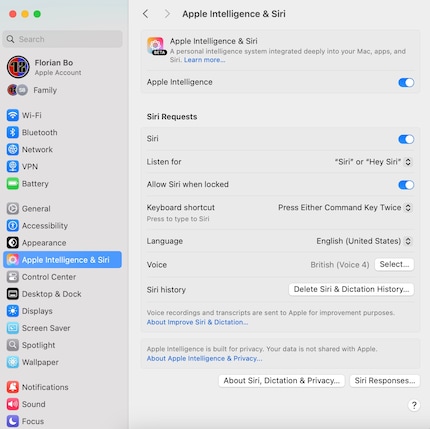

Wenn du Apple Intelligence auf Englisch nutzen willst, musst du zunächst das jeweilige Betriebssystem aktualisieren. Danach stellst du die Systemsprache auf Englisch (US) um und startest dein Gerät neu. Anschliessend findest du unter «Settings» den Punkt «Apple Intelligence & Siri» und – beim ersten Mal – den Punkt «Set up Apple Intelligence».

Tippe in den Einstellungen auf «Apple Intelligence & Siri», danach auf «Join the Apple Intelligence Waitlist» und wartest einige Minuten. Danach folgt ein selbsterklärendes Setup.

Auch Siri wird Englisch mit dir parlieren – immerhin stehen dir hier mehrere Englisch-Versionen und je Version auch mehrere Stimmen zur Auswahl. English (UK) Voice 4 hat einen anständigen Cockney-Akzent. Den nehme ich.

Apple lanciert die Funktionen gestaffelt. Noch ist nicht alles, was Apple im Juni vorgestellt hat, tatsächlich verfügbar. Folgende Dinge kannst du schon nutzen:

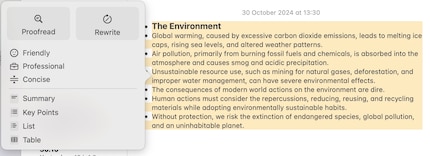

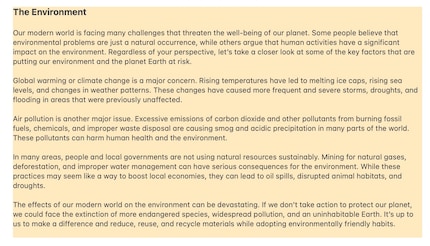

Die KI bietet eine Reihe von Werkzeugen an, mit denen dir das Schreiben und Verstehen von Texten erleichtert werden soll. Wenn du zum Beispiel einen Text in der Notizen-App verfasst hast, kannst du diesen markieren und über «Writing Tools» auf Fehler checken lassen. Die Funktion heisst «Proofread». So weit, so unspektakulär – aber zuverlässig und lernfähig. Schon spannender ist «Rewrite», das deinen Text umschreibt. Die Änderungen sind bei kurzen Texten nicht gross, die KI streicht unnötige Füllwörter raus und benutzt teilweise alternative Begriffe mit der gleichen Bedeutung. Gerade in Fremdsprachen, wenn man nicht sattelfest ist, eine spannende Funktion. Rewrite erkennt auch Zusammenhänge und baute in meinen Testdurchläufen keine schrägen Satzkonstruktionen, wie sie z.B. in den Anfängen der Software Grammarly noch vorkamen.

Die dritte Funktion der Writing Tools ist die Veränderung des Sprachtonus. Schreibst du etwa eine E-Mail, kannst du die KI anweisen, deinen Text in einen gewünschten Stil umzuschreiben: «Freundlich», «Formell» oder «Prägnant». Während ersteres mit blumigen Umschreibungen und dekorativen Feinheiten glänzt, streicht dir die zweite Option alle Ausschweifungen und schlägt einen sachlichen Ton an. Letzteres eignet sich etwa für Powerpoint-Slides, jegliches unterhaltsame, sprachlich dekorative Element fällt weg. Aber auch hier macht Apple Intelligence einen guten Job.

Last but not least hast du die Möglichkeit, dir Texte zusammenfassen zu lassen. Kürzerer Text, Tabellen oder die wichtigsten Fakten als Bullet Points – alles geht.

Per Knopfdruck kannst du immer auf die alte Version deines Textes zurückzuwechseln, um zu vergleichen und zu entscheiden, was dir besser gefällt. Alle diese Features gehen leicht von der Hand und erzielen in meinen Tests starke Ergebnisse.

Auch in der Fotos App kann die neue KI wirken. So gibt es die Funktion «Photo Clean Up». Das ist die Antwort auf Googles Magic Eraser. Die App erkennt auf Anfrage störende Elemente in einem Foto und kann diese entfernen. Aufgefüllt werden die Lücken dann generativ, wie etwa bei Adobe Photoshop. Hier kommt’s etwas darauf an, ob die KI die Objekte selbst erkennt. Oft tut sie das, aber nicht immer. Dann musst du das Objekt, das du entfernt haben willst, umkreisen. Dabei musst du exakt sein, sonst ist die KI nicht zuverlässig.

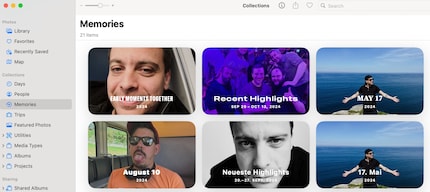

Eine weitere Funktion sind die sogenannten Movie Memories. Gehst du in die Fotos-App und scrollst bis «Memorys», findest du dort den Create-Button. Wichtig zu wissen: Wenn du Apple Intelligence eingerichtet hast, kann es je nach Umfang deines Fotoarchivs einige Tage dauern, bis das klappt. Die Bilder müssen erst verarbeitet werden. Verbinde dafür dein iPhone mit dem WLAN.

Danach kannst du mittels der Prompts Apple Intelligence anweisen, dir ein Video – besser gesagt, eine Slideshow aus mehreren Bildern – zu kreieren. Beispielsweise sowas wie «Create a memory movie from my holidays in London and use punk music in the background».

Weiter wurde die Suchfunktion in der Fotos-App verbessert. Neu versteht das iPhone relativ komplexe Suchbefehle. Statt einfach nur «Hund» oder «Bier» zu suchen – was bei mir in einem Wust an Suchresultaten endet – kannst du spezifischer sein: «Dog next to a lake» oder «Dark haired person with a beer». Auch innerhalb eines Videos kannst du nach einem bestimmten Moment suchen. Apple nennt diese Funktion «Natural Language Search».

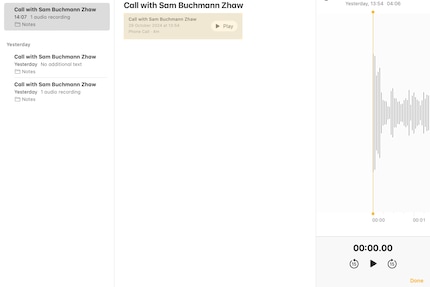

Damit du während eines Telefonats alles Wichtige mitbekommst und nicht wieder vergisst, hilft es, Notizen zu machen. Allerdings geht es zumindest mir so, dass ich nicht gleichzeitig zuhören und schreiben kann. Neu kannst du bei einem Telefonat auf das entsprechende Icon tippen und den Anruf aufzeichnen. Darüber werden beide Parteien per Sprachhinweis informiert. Allerdings war diese Stimme in meinem Telefonat mit Kollege Samuel recht leise. Wenn du gleichzeitig laut sprichst – gewollt oder ungewollt – kann es sein, dass dein Gegenüber den Hinweis nicht mitbekommt.

Das Aufzeichnen funktioniert bei meinem Versuch gut. Mein iPhone erstellt nach dem Ende des Telefonats eine Audiodatei. Vom automatischen Transcript fehlt allerdings jede Spur, obwohl wir das Gespräch in bestem Schwenglisch geführt haben. Dementsprechend funktioniert auch die «Summarize»-Funktion nicht. Warum, ist mir nicht klar.

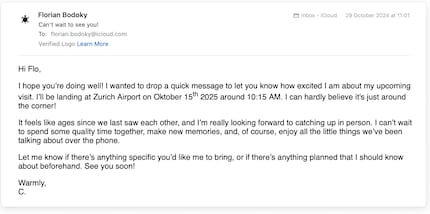

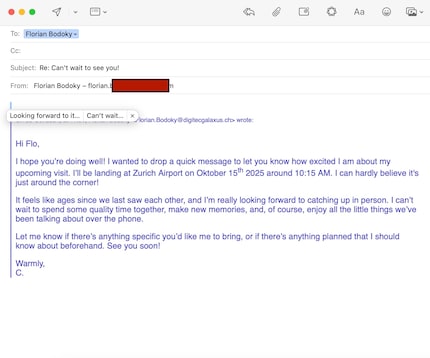

Sehr praktisch finde ich die «Summarize»-Funktion in Apples Mail- und Nachrichten-App. Erhältst du etwa eine E-Mail, wird in der kleinen Vorschau nicht der Beginn der Nachricht angezeigt. Stattdessen sucht die KI im Text nach den relevanten Infos und zeigt sie dir in der Vorschau an. So weisst du, ob du die Mail überhaupt zu öffnen brauchst.

Das Gleiche kann die KI auch in der Nachrichten-App – schade nur, dass diese in meinem Umfeld kaum jemand benutzt. Ausser 2FA-Codes und Bestellbestätigungen vom Pizzakurier erhalte ich dort kaum was.

Die Funktion greift auch bei den Benachrichtigungen aller Apps. Wenn du also von verschiedenen Apps Notifications erhältst, fasst dir die KI zusammen, worum es geht.

Wenn du etwa eine E-Mail erhältst und diese beantworten möchtest, schlägt dir die KI mögliche Textbausteine vor. Das können Outlook und Co. schon lange. Apples KI nimmt aber automatisch Bezug auf Dinge in der Ursprungsmail – zum Beispiel Ankunftszeiten oder wichtige Tasks.

Die KI kann deine E-Mails nach Priorität sortieren. Wenn du also jeden Tag dutzende Nachrichten erhältst, schiebt Apple Intelligence die wichtigsten nach oben. Etwa solche, die eine Deadline enthalten. Für mich ist das nichts – da hätte ich zu viele Bedenken, dass eine Mail, die mir wichtig ist, untergeht. Ich behalte meine chronologische Reihenfolge bei.

Siri ist die älteste Assistentin, aber leider auch die dümmste. Alexa und der Google Assistant haben sie längst überholt. Bis jetzt. Nun kann Siri längere, aneinanderhängende Konversationen führen. Wenn du eine Frage oder einen Auftrag hast, kannst du in Folgesätzen darauf Bezug nehmen – und Siri checkt die Zusammenhänge.

Ausserdem gibt es Type-to-Siri – du kannst die Assistentin also per Text steuern. Das finde ich sehr praktisch, denn es mutet auch nach all den Jahren immer noch seltsam an, in der Öffentlichkeit mit Siri zu sprechen. Siri kann dir auch Termine machen, eine E-Mail fertigstellen und so weiter. Ausserdem hat sie Erklärungen auf Lager, wie du Dinge auf dem iPhone einrichtest. Das ist hilfreich – auch wenn meine Cockney-Version auf den Zuruf «Hey Siri» mit einem mässig motivierten «Hmm?» antwortet.

Viele KI-Funktionen kommen erst noch. Zum Beispiel «Visual Intelligence», also Apples Antwort auf Google Lens. So lassen sich Texte auf Plakaten übersetzen, eine Websuche aufgrund eines Objekts, welches du fotografiert hast, starten, und so weiter.

Zum Ende des Jahres kommt der «Image Playground». Hier kannst du von der KI Bilder erstellen lassen. Artverwandt ist auch das Genmoji-Feature, das via Prompts eigene Emojis generiert. In eine ähnliche Richtung geht «Image Wand». Wenn du etwa in der Notes-App eine Skizze gezeichnet hast, kann die KI diese in ein richtiges Bild umwandeln. Dies kommt mit iOS 18.2 im Dezember. Auch die Anbindung an ChatGPT ist in diesem Monat geplant.

2025 – voraussichtlich im April – wird auch Siri nochmal verbessert. Sie erhält Zugriff auf deinen persönlichen Kontext und die sogenannte On-Screen-Awareness. Das heisst, sie erkennt, was du gerade auf deinem Phone anstellst und kann dir dann in Bezug darauf Unterstützung bieten. Zu diesem Zeitpunkt soll Apple Intelligence auch in weiteren Sprachen verfügbar sein. Darunter Deutsch, Italienisch und Französisch.

Seit ich herausgefunden habe, wie man bei der ISDN-Card beide Telefonkanäle für eine grössere Bandbreite aktivieren kann, bastle ich an digitalen Netzwerken herum. Seit ich sprechen kann, an analogen. Wahl-Winterthurer mit rotblauem Herzen.

Interessantes aus der Welt der Produkte, Blicke hinter die Kulissen von Herstellern und Portraits von interessanten Menschen.

Alle anzeigen